#freedomfightsfake

Publikation: Behind Closed Curtains

Desinformation ist kein neues Phänomen, das erst mit der Digitalisierung aufkam. Vielmehr wurden Desinformationen wohl schon immer eingesetzt, um politischen Gegnern zu schaden, Gesellschaften zu destabilisieren und Regime zu legitimieren. Neu ist, dass sich Desinformationen dank der Digitalisierung mit rasanter Geschwindigkeit verbreiten. Alle können potenzielle Absender – vor allem auch ungewollt – von Desinformationen sein können. Sinkendes Vertrauen in staatliche Akteure und Medien, sowie eine Disruption der gesamten Medienlandschaft und schnellere, einfachere und günstigere Zugänge zu Smartphones und zum Internet unterstützen die Entwicklungen weltweit. Desinformation und die Bedrohung, die durch sie ausgeht, haben es mittlerweile auf die politische Tagesordnung geschafft: Es wird heftig diskutiert,was Desinformation innerhalb von Gesellschaften anrichtet, aber auch welche Gefahr von außerhalb durch einen sogenannten Information Warfare droht. Dass Messenger zur Verbreitung von Desinformation und Verschwörungserzählungen genutzt werden, ist in Deutschland noch recht unbekannt. Erst durch das Bekanntwerden von Netzwerken Rechtsextremer auf diesen Plattformen und zusätzlich durch das Coronavirus kommt das Thema Desinformation auf Messengern langsam in der deutschen Öffentlichkeit an.

Desinformation muss in seiner Vielfältigkeit näher betrachtet werden. Denn das Thema ist für die innere Sicherheit, aber auch für den gesellschaftlichen Zusammenhalt und Frieden von enormer Bedeutung. Viel zu oft wird vergessen, dass gerade im nicht-politischen Bereich verbreitete Desinformation ein hohes Risiko birgt: Rund um das Coronavirus ist Anfang 2020 weltweit eine große Menge an Desinformation im Umlauf. Von falschen Studien, angeblichen Selbsttests und wirkungslosen Präventionsmaßnahmen ist alles dabei. Die Weltgesundheitsorganisation spricht daher von einer Infodemie. Diese Infodemie birgt ein erhebliches Gesundheitsrisiko für alle Menschen.

2022 werden drei Milliarden Menschen Messengerdienste weltweit nutzen. Viele davon werden keine dem digitalen Zeitalter angemessene Medienkompetenz besitzen oder gar Analphabeten sein. Das gilt für Nutzerinnen und Nutzer weltweit. Nicht nur die Art, wie wir kommunizieren, ändert sich rasant, sondern auch, wie wir Medien und Nachrichten konsumieren. Die Zeitung vom Küchentisch, das gemeinsame Nachrichten schauen am Abend, das Telefongespräch – all das verlagert sich in nicht mehr von außen wahrnehmbares Kommunizieren und Konsumieren. Damit müssen wir als Gesellschaft(en) lernen umzugehen. Welche Erfahrungen und Erkenntnisse haben wir weltweit mit Desinformation via Messenger? Wie komplex ist dieses Phänomen und wird der Komplexität bisher in der öffentlichen Diskussion ausreichend Rechnung getragen? Welche Ansätze können zu einer aufgeklärteren, resilienteren Gesellschaft beitragen?

Die volle Online-Version der Publikation können Sie hier abrufen.

Sich der Komplexität bewusst werden – Begriffsdefinitionen

Im Zusammenhang mit “Desinformation” wird sehr häufig der Begriff “Fake News” verwendet. Dieser soll hier vermieden werden, da er zum einen nur äußerst ungenügend beschreiben kann, welche diversen Arten der Informationen verbreitet werden, die zu falschen oder manipulativen Informationen führen. Der Begriff “Fake News” wird weltweit vornehmlich von Politikerinnen und Politikern eingesetzt, um die Berichterstattung von Nachrichtenorganisationen zu diskreditieren. Er wird genutzt, um die freie Presse zu umgehen und zu unterminieren und sollte daher nicht für einen Diskurs über Desinformationen genutzt werden.

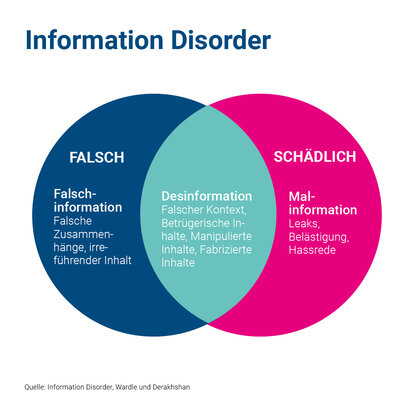

Um die Wirkung von Desinformation verstehen und besprechen zu können, müssen nicht nur die Arten der Informationen in dieser „Information Disorder“ (zu Deutsch: „Informationsstörung“) definiert werden, sondern auch ihre Phasen und Elemente. In Anlehnung an die umfangreiche Arbeit von Dr. Claire Wardle und Hossein Derakhshan, soll das Framework hier vorgestellt werden:

Die drei Typen der Information Disorder

Unter dem Begriff “Fake News” werden häufig drei Typen der Information Disorder subsumiert. Zu unterscheiden sind:

- “Mis-Information” (Falschinformation): Eine Information, die zwar falsch ist, aber nicht mit der Intention erstellt wurde, Schaden anzurichten. Hier unter kann auch Satire fallen, wenn sie vom Interpreten nicht als solche erkannt wird, sondern im Glauben, dass es sich um wahre Tatsachen handelt, verbreitet wird.

- “Dis-Information” (Desinformation): Eine Information, die falsch ist und erstellt wurde, um einer Person, einer Gruppe, einer Organisation oder einem Staat Schaden zuzufügen. Dazu kann auch gehören, dass wahre Informationen falsch kontextualisiert werden, um bewusst Schaden zu verursachen.

- “Mal-Information” (hierunter fällt zum Beispiel sogenanntes Doxing): Eine Information, die richtig ist, aber genutzt wird, um Schaden anzurichten. Beispielsweise das Veröffentlichen privater Chats.

Die drei Elemente der Information Disorder

- Der Agent: Wer hat die Information kreiert, produziert und/oder distribuiert und was war die Motivation dahinter? Er kann sowohl das „Mastermind“ hinter einer Desinformationskampagne sein, als auch ein Unterstützer einer Kampagne, der die Desinformation verbreitet. Ebenso ist eine Personalunion möglich. Auch Menschen, die eine Desinformation unwissentlich verbreiten, weil sie sie für wahr halten, sind ein „Agent“ bei der Verbreitung. Die Rolle des Agenten kann sich unter mehreren Personen aufteilen.

- Die Nachricht: Was für ein Format hat die Information? Welche Charakteristika hat sie?

- Der Interpret: Wie wurde die Nachricht bei der Person, die sie empfangen hat interpretiert? Wie wurde darauf, wenn überhaupt, reagiert?

Die drei Phasen der Information Disorder

- Die Kreation: Erstellung der Information.

- Die Produktion: Überführung der Information in ein Nachrichten-Produkt.

- Die Distribution: Die Veröffentlichung oder Verbreitung der Information.

Wardle und Derakhshan machen darauf aufmerksam, dass es wichtig ist zu berücksichtigen, dass der Agent, der die Information erstellt, häufig jemand völlig anderes ist, als der Agent, der die Information distribuiert. So ist die Motivation eines “Masterminds”, der zum Beispiel die staatlich finanzierte Desinformationskampagne kreiert, eine völlig andere als die eines “Trolls”, der die Desinformation im Netz verbreitet. Einmal produzierte Informationen können zudem verändert und damit neu produziert werden. Auch die Wege der Distribution können sich darauf aufbauend verändern. Damit verändern sich auch die Agenten, ebenso wie die Interpretationen des Empfängers. Die Erstellung und Verbreitung von Desinformation ist also ein komplexer Prozess, der in der Regel nicht als ein abschließender Prozess zu betrachten ist und in dem Rollen und Funktionen eindeutig zugeordnet werden können. Ebenso gehören in diesen Prozess alle, die eigentlich keine Desinformation absichtlich teilen wollen, sie aber dennoch verbreiten, zum Beispiel zum debunking oder um den Gegner lächerlich zu machen. Wardle und Derakhshan haben dies am Beispiel der vermeintlichen Unterstützung Donald Trumps durch Papst Franziskus im Präsidentschaftswahlkampf 2016 verdeutlicht.

Sich diese Komplexität vor Augen zu führen ist wichtig, um das Phänomen Desinformation besser verstehen zu können und Ansätze für Lösungen zu finden. Falsch- und Desinformationen werden von manchen Menschen verbreitet, weil sie diese witzig finden. Sie vergessen dabei aber, dass die Empfänger, also die Interpreten,

diesen “Humor” eventuell nicht verstehen und die Falsch- beziehungsweise Desinformation für eine Tatsache halten und empört weiterverbreiten. Ebenso ist einigen Agenten, die eine Desinformation verbreiten, nicht bewusst, dass sie dies tun: Sie verbreiten etwas, weil sie den Inhalt für wahr halten, nicht, weil sie bewusst manipulieren wollen. Hier liegt die Intention zur Manipulation beim Ersteller der Nachricht. Um die (unbewussten) Beweggründe für die Verbreitung von Desinformationen zu verstehen, müssen der Medienkonsum und die psychologischen Effekte bei der Verbreitung von Informationen betrachtet werden.

Medienkonsum und psychologische Effekte

Der Konsum von Nachrichten und Medien war lange Zeit ein deutlich gesellschaftlicheres Ereignis als heute; es gab eine gemeinsame Realität (“shared reality”): Nachrichten wurden (gemeinsam) vor dem Fernseher konsumiert und gegebenenfalls besprochen. Zeitungen und Radio verbreiteten (und verbreiten) Informationen, die zwar unterschiedliche Nuancen haben konnten, aber diese Informationen konnten und können nicht lediglich einem kleinen geschlossenen Kreis vorgehalten werden.

Wer eine Zeitung kauft, kann lesen was drin steht, wer einen bestimmten Radiosender einstellt, wird hören, was dort gesendet wird. Dieses Vorhalten von Informationen ist heute zum Beispiel durch sogenanntes Targeting von Inhalten auf sozialen Netzwerken wie Facebook oder Twitter möglich. Die Betreiber einer Seite oder eines Accounts können definieren, vornehmlich durch bezahlte Anzeigen, welche Nutzerinnen und Nutzer einen Inhalt zu sehen bekommen sollen und welche nicht: Man kann beispielsweise nach Geschlecht, Wohnort, Alter oder politischer Einstellung selektieren, um nur wenige Beispiele der möglichen Zielgruppendefinition zu nennen. Zwar gibt es mittlerweile die Möglichkeit beispielsweise auf Facebook einzusehen, welche Anzeigen der Betreiber einer Seite geschaltet hat. Um dies zu erfahren, muss man allerdings zum einen wissen, dass ein solches Targeting stattfindet, zum anderen muss die Transparenzseite proaktiv gesucht und besucht werden.

Durch die schnelle Verbreitung von Informationen, deren schiere Masse und die Möglichkeit, spezielle Zielgruppen mit einer Information über die sozialen Netzwerke zu versorgen, verringert sich die “gemeinsame Realität” einer Gesellschaft erheblich.

Genauso bedeutsam sind kommunikationspsychologische Aspekte in diesem Zusammenhang: Der Wissenschaftler James Carey ist der Meinung, dass wir die rituelle Bedeutung von Kommunikation näher betrachten müssen, denn diese sei mehr als der bloße Austausch von Informationen zwischen Personen. Kommunikation spiele eine fundamentale Rolle für das Kreieren von gemeinsamen Vorstellungen: Die Arten von Informationen, die Menschen konsumieren, und die Art und Weise, wie sie diese interpretieren, werden signifikant davon beeinflusst, wie man sich selbst wahrnimmt und welchen gesellschaftlichen Gruppen man sich zugehörig fühlt. Gerade durch das Liken und Kommentieren, sowie – insbesondere in Messengern – Teilen von Inhalten, verdeutlichen wir unserem Umfeld unsere Zugehörigkeit. Soziale Plattformen verstärken diese Mechanismen.

Der Soziologe Michel Maffesoli legte bereits 1996 in seinem Buch “The Time of the Tribes” dar, dass man die vielen verschiedenen kleinen und temporären Gruppen berücksichtigen muss, in denen ein Mensch über den Tag verteilt Mitglied ist, um sein oder ihr Verhalten zu verstehen. Wardle und Derakhshan argumentieren, dass er damit genau beschrieb, wie sich Nutzerinnen und Nutzer heute auch online verhalten und warum sie welche Informationen posten oder teilen. Diese "Stammesmentalität” erkläre auch, warum so viele Social-Media-Nutzerinnen und -Nutzer Falsch- und Desinformationen teilen, obwohl sie Zweifel an der Richtigkeit der Information haben: Sie würden damit vor allem ihre Zugehörigkeit zu einer Gruppe verdeutlichen und unter Beweis stellen wollen.

Erschwerend kommt hinzu, dass Falsch- und Desinformationen oftmals Gefühle wie zum Beispiel Überlegenheit, Wut oder Angst ansprechen. Das führt dazu, dass solche Nachrichten sehr viel eher weiterverbreitet werden. Ein gemeinsames emotionales Erleben (wie zum Beispiel gemeinsame Abscheu, gemeinsame Empörung) erhöht das Zusammengehörigkeitsgefühl innerhalb einer Gruppe. Das erklärt auch, weshalb emotionsgeladene Inhalte auf allen sozialen Plattformen besonders gerne geliked und geteilt werden. Desinformation hat zudem häufig das Ziel gesellschaftliche Spaltungen zu fördern: Es geht dabei um ein “wir gegen die” – sei es bei politischen Kontrahenten oder zur Verstärkung von ethnischen, religiösen oder ökonomischen Konflikten.

Nicht nur die Geschwindigkeit, mit der solche Desinformation verbreitet wird, ist ein Problem. Sogenanntes Fact-Checking kann hier erst sehr spät reagieren. Es ist fraglich ob Versenderinnen oder Versender von Falsch- bzw. Desinformation – insbesondere die, die diese unbewusst verbreitet haben – zeitnah oder überhaupt die Fakten und damit die Korrektur erhalten. Es ist außerdem zu bezweifeln, ob auf Emotionen basierende Einstellungen durch die Konfrontation mit Fakten korrigiert werden können. Wardle und Derakhshan gehen daher davon aus, dass die Verbreitung von qualitativ hochwertigen Informationen nicht die Lösung sein kann: Fakten sprechen die Ratio an, Desinformation triggert Emotionen - und Fakten und Emotionen werden im Hirn unterschiedlich verarbeitet. Eine mögliche Lösung: Gleiches mit Gleichem bekämpfen - also über die soziale Akzeptanz in der jeweiligen Gruppe. Es müssen also folgerichtig Mechanismen gefunden werden, die das Verbreiten von Falsch- und Desinformation vor der eigenen sozialen Gruppe äußerst peinlich erscheinen lassen.

Auch Alexander Ritzmann weist darauf hin, dass wir eher unserer eigenen Gruppe glauben und dass dieses “Stammesdenken”, das Zugehörigkeitsgefühl zu einer Gruppe – das kann von einer Religion, politischen Partei bis hin zu einem Fußballclub alles sein – ausschlaggebend dafür ist, was wir glauben, beziehungsweise für wahr halten, und was nicht. Desinformationen sprechen außerdem häufig tief verankerte Wertvorstellungen an, die nicht mit Fakten überwunden werden können: Wer beispielsweise glaubt, dass einzelne Nationen besser sind als andere, dass Männer über Frauen stehen oder dass Abtreibungen verboten werden sollten, wird sich nicht einfach mit Fakten überzeugen lassen und seine Meinung ändern. Der Prozess zu einer Änderung der Wertvorstellung ist langwierig und komplex.

Bilder zur einprägsamen Verbreitung von Desinformationen

Selten wird im Rahmen von Desinformation über die Form der Information gesprochen. Das ist aber wichtig, um gegen Desinformation – eventuell auch automatisiert – vorzugehen, sondern auch um beurteilen zu können, wie schnell und nachhaltig Desinformation beeinflussen kann. In der Diskussion wird häufig antizipiert, dass es sich vornehmlich um Text beziehungsweise Links zu längeren Texten (“Nachrichten”, beziehungsweise fabricated news) mit Desinformation handelt. Bisherige Untersuchungen zeichnen ein anderes Bild.

In Brasilien hat sich das Projekt Comprova – ein Zusammenschluss von Newsrooms und Journalistinnen und Journalisten – vor den letzten Präsidentschaftswahlen intensiv mit Informationen, die über Messenger versendet wurden, auseinandergesetzt. Comprova hat Falsch- und Desinformationen debunkt, beziehungsweise Informationen verifiziert und dabei auch die Formate der Nachrichten analysiert: Ein Großteil waren Bilder, die mit Nachrichten versehen waren, die einem bestimmten politischen Lager zuzuordnen waren. Ebenso populär waren offizielle Dokumente und Nachrichten, die aus dem Zusammenhang gerissen wurden, sowie Screenshots von digitalen Konversationen, die teilweise echt, teilweise gefälscht waren. Memes waren kaum in den übermittelten Daten zu finden. Comprova geht davon aus, dass sie nicht als ernst empfunden wurden und daher nicht zur Prüfung übermittelt wurden, obwohl Memes gerade durch “Humor” propagandistische Botschaften vermitteln. Die (unbewusste) Vermittlung propagandistischer Botschaften durch Memes geschieht, indem der politische Gegner lächerlich gemacht wird, rassistische, sexistische, antisemitische etc. Stereotype aufgegriffen werden und als „witzig“ dargestellt werden. Ebenso mittels falscher Zitate, die auf Memes abgebildeten Personen in den Mund gelegt werden. Videos waren das am zweithäufigsten übermittelte Format an Comprova, den kleinsten Teil machten Sprachnachrichten aus.

Texte können theoretisch schnell von Texterkennungssoftware erkannt werden, um so markiert oder gar gelöscht zu werden. Links zu Webseiten bieten noch die Hoffnung, dass eine Überprüfung der Webseite. Nutzerinnen und Nutzer erkennen lässt, dass es sich hier um Desinformationen handelt. Bei Bildern, Videos und Sprachnachrichten ist dies jedoch schwierig bis unmöglich. Noch schwieriger wird das Ganze bei manipulierten Ton- oder Videoaufnahmen, sogenannten “Deep Fakes”.

Schon in den 70er und 80er Jahren des vergangenen Jahrhunderts wurde anhand von Fotografie und TV-Sendungen gezeigt, dass Menschen Bilder fundamental anders wahrnehmen als Text: Das Gehirn kann Bilder deutlich schneller verarbeiten. Unsere Fähigkeiten, Inhalte kritisch zu hinterfragen, sind bei (Bewegt-) Bildern deutlich geringer; Memes werden beispielsweise eher als humoristisch, denn als politisch motiviert, beziehungsweise manipulativ wahrgenommen. Im US-Wahlkampf 2016 spielten Memes eine große Rolle: Auf Webseiten wie 4Chan wurden beispielsweise Memes gegen Hillary Clinton getestet und die, die die beste Resonanz zeigten, wurden dann auf Reddit im Pro-Trump Forum “The_Donald” veröffentlicht. Von dort wurden sie dann teilweise von der Trump-Kampagne aufgegriffen und in weitaus breiter bekannte und genutzte soziale Netzwerke überführt. Dadurch, dass Facebooks Algorithmus im Newsfeed Bilder und Videos gegenüber Links (beispielsweise zu Nachrichtenartikeln) bevorzugt, finden solche Memes oder andere Bilder und Videos über dieses Netzwerk eine deutlich größere Reichweite. Diese Memes können aus dem Newsfeed über den Facebook Messenger sowie als Link oder Screenshot auch über andere Messenger wie WhatsApp weiterverbreitet werden.

First Draft, eine Nichtregierungsorganisation, hat während der Wahlen in Frankreich und Großbritannien 2017 Projekte unterstützt, die sich mit dem Debunken von Desinformationen beschäftigt haben. Auch hier wurde festgestellt, dass (Bewegt-)Bilder mit Abstand den größten Anteil an der am meisten geteilten Desinformation ausmachten und am schwersten zu widerlegen waren – darunter Infografiken und Memes. “News”-Webseiten mit fabrizierten, also komplett frei erfundenen “Nachrichten”, wie sie während der US-Wahl 2016 zu sehen waren, gab

es während der Wahlkämpfe in Frankreich und Großbritannien hingegen nicht.

Messengerdienste – Ein Überblick

Messengerdienste haben im vergangenen Jahrzehnt rasant an Beliebtheit und damit Nutzerinnen und Nutzer dazu gewonnen. Blickt man auf alle Plattformen, also soziale Netzwerke wie Facebook und Twitter, und Messenger zusammen, dann ist WhatsApp nach Facebook und YouTube die weltweit drittgrößte Plattform und der am weitesten verbreitete Messenger. Dicht gefolgt vom Facebook Messenger und WeChat, das vornehmlich in China genutzt wird, aber auch in anderen Ländern immer beliebter wird. Auch soziale Netzwerke wie Instagram haben die Möglichkeit private Nachrichten zu versenden. Facebook, zu dem neben WhatsApp auch Instagram gehört, versucht auf all seinen Plattformen Menschen in private(re) Kommunikation zu drängen. Damit gibt das Unternehmen vor, den Rufen nach mehr Privatheit Folge zu leisten, verwechselt dabei aber “private” mit “privacy”, also Themen des Datenschutzes, für die es bislang häufig in der Kritik stand. Zudem kann sich Facebook durch diese “privaten”, teils auch verschlüsselten Räume aus der Verantwortung bezüglich Desinformationen und Hate Speech ziehen, da sie aufgrund eben dieser Verschlüsselung nicht mehr die Inhalte einsehen und damit dagegen vorgehen können. Dies gilt für Gruppen auf Facebook, für den Facebook Messenger, sowie für den privaten Austausch über Direktnachrichten bei Instagram (was ebenfalls zu Facebook gehört). Ähnlich betrachtet werden muss auch Snapchat mit seinen weltweit 382 Millionen Nutzerinnen und Nutzern.

Der Messenger Telegram hat, laut zuletzt 2018 veröffentlichten Zahlen, 200 Millionen Nutzerinnen und Nutzer weltweit. Der Schweizer Messenger Threema fünf Millionen (Stand 2018). Zu den Messengern Signal und Wire sind keine Zahlen bekannt. Der Messengerdienst Discord, der besonders bei Gamern beliebt ist, verzeichnet 250 Millionen Nutzeraccounts weltweit.

Nachrichten bei den Messengern WhatsApp, Threema, Signal und Wire sind standardmäßig Ende-zu-Ende verschlüsselt. Telegram und Facebook Messenger bieten eine Verschlüsselung an, die aber aktiv durch einen “geheimen Chat” ausgewählt werden muss. Discord, WeChat und die Direktnachrichtenfunktion von Instagram und Snapchat haben keine Ende-zu-Ende-Verschlüsselung und könnten daher von den Plattformen und Dritten leicht eingesehen werden.

Im Interview mit der Süddeutschen Zeitung erklärt Ann Cathrin Riedel, welche Messenger besonders betroffen sind, warum sie den Begriff "Fake News" meidet und was Nutzer tun können.