Künstliche Intelligenz

Demokratien im Wandel: KI als Chance und Herausforderung im Superwahljahr

Das Jahr 2024 markiert einen entscheidenden Test für Demokratien weltweit. In diesem sogenannten Superwahljahr, in dem rund vier Milliarden Menschen stimmberechtigt sind, stehen wir vor einer historischen Herausforderung. In 70 Ländern finden Wahlen statt, wobei in 43 Ländern ein freiheitlicher und fairer Wahlprozess gewährleistet ist. Doch während Wahlen allein keine Garantie für die Existenz und Stärke der Demokratie bieten, sind sie doch unverzichtbar für ihr Funktionieren. Es ist somit außerordentlich wichtig, die Integrität von Wahlen zu schützen und zu gewährleisten.

Ein in den letzten Jahren immer akuteres Risiko ist die gezielte Informationsmanipulation und Einflussnahme durch Desinformation und das Schüren und Verstärken innerer Spaltungen. Russland hat seit dem Kalten Krieg im Rahmen von „aktiven Maßnahmen“ bewährte Methoden der Einflussnahme entwickelt; doch nie zuvor waren sie so gefährlich. Der Grund liegt darin, dass sich in den letzten Jahren fundamental verändert hat, wie wir als Gesellschaft Informationen konsumieren und weitergeben. Social-Media-Plattformen wie Facebook, Twitter, TikTok, Telegram und andere dominieren mittlerweile die Informationslandschaft. Statt durch traditionelle Gatekeeper werden Inhalte über eine Vielzahl von Plattformen und Messaging Apps verbreitet. Ihnen kommt also eine zentrale Verantwortung zu. Das analysiert auch Dr. Constanze Kurz in dem Webtalk „Wie KI, Deepfakes und ‚social media‘ unsere Wahlen beeinflussen“.

Die Hoffnung auf einen Brussels-Effect

Die meisten großen Plattformen haben zwar klare Richtlinien beispielsweise bezüglich Wahlwerbung und sind bestrebt, diese zu kennzeichnen und Faktenchecks einzuführen. TikTok etwa behauptet, dass sie im 3. Quartal 2023 99 % aller Inhalte, die wegen Fehlinformationen in Bezug auf Wahlen und die Gesellschaft entfernt wurden, bereits entfernt hätten, bevor sie ihnen überhaupt gemeldet wurden. Doch es gestaltet sich schwierig, an die Daten zu gelangen, um solche Zahlen tatsächlich zu überprüfen.

Die EU hat darauf mit Gesetzgebungen wie dem Digital Services Act (DSA) reagiert, um die Grund- und Verbraucherrechte im digitalen Raum besser zu schützen. Große Plattformen sollen durch Inhaltemoderation die Verbreitung von illegalen Hassbotschaften eindämmen und sind auch zu Gegenmaßnahmen im Bereich der Desinformation verpflichtet. Dabei liegt der Fokus auf systemischen Risiken, die Plattformen für systematische Informationskampagnen durch Bots oder Kampagnen, wie die vom AA aufgedeckte Doppelgänger Kampagne, anfällig machen. Vereinfacht werden solche Kampagnen durch immer besser werdende generative künstliche Intelligenz (KI). Die Auswirkungen von KI auf Desinformation, Wahlkampf und politische Kommunikation sind bereits international zu beobachten. Das Policy Paper “Vilify, ridicule, disinform - political communication and media trust in the age of generative AI” der Friedrich-Naumann-Stiftung für die Freiheit schaut darauf, wie bereits jetzt generative KI für politische Kommunikation genutzt wurde.

Dabei wird deutlich, dass besonders Ton, Bild und Video im Vordergrund stehen. Programme wie Midjourney erlauben es, in Sekundenschnelle Bilder zu kreieren. Das macht sich unter anderem die AfD zunutze, um verhetzende Inhalte zu verbildlichen. Ein Beispiel ist AfD-Fraktionsvize Kleinwächter, der „arab refugees in Berlin“ bei Midjourney eingibt, um seine Tweets gegen geflüchtete Menschen mit einem künstlich erschaffenen Bild von wütenden und schreienden Männern auszuschmücken.

Dass es mittels KI generiert wurde, ist auf dem Bild nicht gekennzeichnet. KI sowohl in seiner generativen Form als auch eingebettet in die Empfehlungsalgorithmen bei TikTok oder X (ehemals Twitter) verschlimmern so Hass und Hetze im Internet. Es ist also dringend erforderlich, Strategien zu entwickeln, um die Anwendung von KI für verhetzende politische Kommunikation einzudämmen.

Tattoos für die KI als Gegenmittel

International diskutiert wird eine Kennzeichnungspflicht für KI-generierten Inhalt und ihre Umsetzung. An einer sogenannten Tätowierung KI-generierter und authentischer Inhalte arbeiten Firmen wie Adobe und Microsoft in der Coalition for Content Provenance and Authenticity (C2PA). Als erster Schritt sollen im Vorlauf der US-Wahlen alle offiziellen und authentischen Wahlkampfbilder und -materialien als solche gekennzeichnet werden. Doch für viele andere Wahlen wird C2PA nicht mehr rechtzeitig nutzbar sein. Im europäischen AI Act ist eine Kennzeichnungspflicht von KI generierten Inhalten durch die Entwickler bereits vorgesehen. Eine solche kann zwar umgangen werden, bringt aber eine weitere Hürde für massenhafte Verbreitung ungekennzeichneter Inhalte mit sich. Man darf und muss in diesem Punkt auf einen Brussels-Effect hoffen. Darauf, dass die Marktmacht Europas so signifikant ist, dass Entwickler eine automatische Kennzeichnung international einsetzen. Für das Superwahljahr 2024 dürfte es jedoch schon zu spät sein. Auch innerhalb der EU, denn für die Umsetzung der Verordnung haben Staaten und Firmen zwei Jahre Zeit.

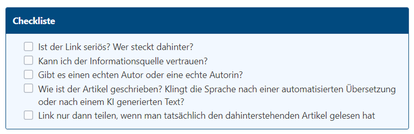

Auch Bundesjustizminister Buschmann spricht sich für eine Kennzeichnungspflicht von KI-generiertem Material aus. Für die kommenden Wahlen in Deutschland könnten sich in einem ersten Schritt die demokratischen Parteien auf einen Code of Conduct einigen, welcher die Kennzeichnung im Wahlkampf festlegt. Neben einer Vorbildfunktion würden solche Kennzeichnungen auch bei Bürgerinnen und Bürgern das Bewusstsein für die Prävalenz von KI-generierten Inhalten im Netz stärken. Kurz betont, dass Nutzerinnen und Nutzer durchaus in der Lage sind, Desinformation und synthetische Medien zu erkennen. Dafür reiche eine einfache Checkliste aus, die Bürgerinnen und Bürger hauptsächlich dazu bringen soll, keine Inhalte zu verbreiten, die sie nicht gelesen haben:

Auch argumentiert Constanze Kurz für einen kritischeren Umgang mit dem Verbreiten von Desinformation. Politikerinnen und Politiker sollten beispielsweise Elon Musk, welcher nachweislich über seine Plattform X (ehemals Twitter) Desinformation geteilt und verbreitet hat, keine Plattform bieten, indem sie sich mit ihm fotografieren lassen. Ein solches Handeln sende das falsche Signal. Auch die Normalisierung des Wahlkampfes auf Plattformen, die anfällig für Desinformation sind, sei problematisch. Die Debatte um die AfD-Präsenz auf TikTok verdeutlicht das Dilemma, welchem demokratische Parteien gegenüberstehen. Überlässt man jedoch der AfD den Debattenraum, so überlässt man ihn einer Partei, die Hass, Hetze und Verschwörungstheorien verbreitet.

Vertrauensverlust in Demokratien feuert Desinformation an

Bereits Anfang des Jahres war Taiwan im Vorlauf der eigenen Wahlen einer großangelegten Kampagne zur Einflussnahme durch China ausgesetzt. Taiwans Bevölkerung ist jedoch erstaunlich resilient und hat sich der Kampagne entschieden entgegengestellt. Gewonnen hat die demokratische und Festlandchina kritisch gegenüberstehende DPP. Doch die wenigsten Länder können eine solche Resilienz aufweisen. Das zeigt auch, dass es weit mehr als nur Regulierung bedarf. Ebenso wichtig ist Medienkompetenz und zivilgesellschaftliches Engagement. Beides ist außerordentlich hoch in Taiwan.

Auch Indien, die größte Demokratie der Welt, wählt dieses Jahr. Besorgniserregend ist, dass Indien während der zweiten Amtszeit von Narendra Modi vom Think Tank Freedom House in seinem Freiheitsstatus von "frei" auf "teilweise frei" herabgestuft wurde. Wie KI Wahlen nicht nur in den USA oder Europa, sondern weltweit beeinflusst, muss in diesem Superwahljahr dezidiert herausgearbeitet werden. Die DGAP widmet sich dem in einem Projekt zum „AI Election Year“. Auch die Friedrich-Naumann-Stiftung wird mit ihren Partnern, zum Beispiel in Südafrika, auf die Auswirkungen von KI auf die dortigen Wahlen blicken.

Doch es bedarf mehr als nur technischer Lösungen wie Kennzeichnungspflichten und Markierung von Falschnachrichten oder politischer Werbung. Die Autoren des Policy Paper “Vilify, ridicule, disinform - political communication and media trust in the age of generative AI” legen dar, dass die Anfälligkeit für Desinformation und Verschwörungsmythen im Netz im engen Zusammenhang mit schwindendem Vertrauen in die Demokratie und den Staat an sich liegt.

Besonders alarmierend ist in diesem Zusammenhang eine aktuelle Studie des Deutschen Beamtenbundes, welche aufzeigt, dass 69 Prozent der gesamten Bevölkerung den Staat als überfordert mit seiner Arbeit einschätzt. Dieser Wert ist in den letzten Jahren gestiegen. Hinzu kommt die Prognose, dass bis 2030 dem öffentlichen Dienst über eine Million Fachkräfte fehlen könnten, was einem Fünftel der aktuellen Belegschaft entspricht. Was bedeutet dieser Vertrauensverlust in die Funktionsfähigkeit des Staates auch mit Blick auf die gesellschaftliche Anfälligkeit für Desinformation und ausländische Propaganda? In Deutschland stehen neben den Europawahlen im Mai auch Landtagswahlen in Sachsen, Thüringen und Brandenburg an. Der Aufschwung der in den drei Ostländern als rechtsextrem eingestuften AfD und rechtspopulistischer Bewegungen in anderen Staaten stellen eine ernsthafte Bedrohung für die Demokratie dar, denn sie greifen die Grundlagen des Zusammenlebens durch diskriminierende, verächtlichmachende Propaganda an und bauen Sündenböcke wie die sogenannten Eliten, Ausländer oder Juden auf. Sie nutzen damit spaltende Narrative, um die Meinungsbildung in ihrem Sinne zu beeinflussen.

Wie KI die Demokratie stärken kann

Um Vertrauen zurückzugewinnen und die Resilienz für unsere Demokratie zu erhöhen, muss die Leistungsfähigkeit des Staates und seiner Verwaltung drastisch verbessert werden. Dabei führt nichts an einer besseren Digitalisierung vorbei. Dazu gehört auch der strategische Einsatz von KI, um Demokratie zu stärken. In diesem Kontext ist es entscheidend, die konkreten Potenziale von KI für die Stärkung der Demokratie realistisch zu bewerten. Auch damit beschäftigt sich die Stiftung intensiv in einem bald verfügbaren Gutachten. In weltumspannenden Beispielen für den erfolgreichen Einsatz von KI zur Stärkung der Demokratie wird das Potenzial der Technologie in diesem Bereich deutlich. So erhöht der Kommunaler Gebärdensprach-Avatar in Deutschland in vielen Städten und Kommunen bereits jetzt die Barrierefreiheit und fördert gesellschaftliche Inklusion. Durch die Verarbeitung umfangreicher Datensätze und Mustererkennung eignen sich KI-Systeme hervorragend, um gegen Korruption vorzugehen. In der Ukraine wird die Anwendung Dozorro genutzt, um korruptionsanfällige Ausschreibungen und Vergaben im öffentlichen Beschaffungswesen zu finden. Auch das deutsche System KriminelleNetzwerke nutzt Mustererkennung, um Korruption und Abrechnungsbetrug im deutschen Gesundheitswesen aufzudecken. Beide Anwendungen fördern Rechtsstaatlichkeit und unterstützen Ermittlungsbehörden in ihrer Arbeit. Auch das Europäische Parlament nutzt KI. Mit dem EP summariser sollen Textdokumente aus dem großen Datenschatz des Parlaments als relevant erkannt und in einem zweiten Schritt inhaltlich korrekt zusammengefasst werden können. Auf diese Weise sollen vorhandene Datenbestände und Informationen besser im Rahmen der Gesetzgebung genutzt werden können. Dafür stellt es den Abgeordneten, deren Mitarbeitenden und dem Verwaltungspersonal des Parlaments verschiedene KI-Systeme insbesondere zur mehrsprachigen Textverarbeitung zur Verfügung. Schlussendlich soll so eine bessere Gesetzgebung erreicht werden. Das Gutachten wird bei der re:publica im Mai vorgestellt und ist ein wichtiger Schritt, um die Potenziale von KI zu untersuchen und geeignete Maßnahmen zu entwickeln.

Liberale Demokratien auf der Welt befinden sich aktuell in einer Weise unter Beschuss, wie lange nicht. Künstliche Intelligenz ist auf vielen Ebenen eine Herausforderung und Bedrohung, doch sie ist auch ein Tool, um Demokratien zu stärken, gegen Informationsmanipulation vorzugehen und Vertrauen zurückzugewinnen. Man muss sie nur richtig nutzen und zusammen mit einem transformativen Mindset annehmen.